原文标题:If you don't understand AI by the end of this, the next decade will confuse you

原文作者:@AnishA_Moonka

原文链接:https://x.com/AnishA_Moonka/status/2033128021092073502

编译:超算百科

大多数人觉得 AI 就是个聊天机器人。

我完全理解这种想法。你打开 ChatGPT,让它帮你改封邮件,它搞定了。那种感觉简直像变魔法一样,你走开时觉得自己已经懂了 AI 是怎么回事。但这就像是在餐厅刷信用卡买单,就以为自己弄懂了 Visa 是怎么赚钱的一样——你只是使用了产品,却没看到背后的系统。

过去一年的大部分时间里,我都在试图弄清楚 AI 领域的真金白银到底流向了何处。老实说,我花了极其漫长、甚至长到让人汗颜的时间,才意识到自己一直看错了层级。我盯着 ChatGPT、Claude 和 Gemini 这些看得见、摸得着的东西,却没发现高达 7000 亿美元的资金正悄无声息地投入到那些我连名字都叫不出来的基础设施中:从未听闻的芯片、缩写怪异的封装技术、散热系统、发电厂……在德克萨斯、爱荷华和海德拉巴,钢筋混凝土正源源不断地浇筑进建筑工地。

一年前,我认识的人里还没谁在聊这些。但现在,所有人都在谈论。

这篇文章会很长。我想带你梳理一遍整个 AI 价值链,从给数据中心供电的电力,到你手机上的 App,每一层都不放过。我会用一种即便你这辈子没读过一份财报也能听懂的方式,把这件事讲清楚。

文中出现术语时我会解释。我会为每一个观点附上真实的数据。我也会对那些我还没完全搞懂的部分保持诚实——毕竟,确实还有那么几处。

我们开始吧。

01 五层蛋糕模型(以及为何没人聊底层那四层)

“AI 就是基础设施。就像互联网和电力一样,它也需要工厂。” —— 黄仁勋

大多数人对 AI 的理解大概是这样的:一个聪明的电脑在回答问题。

这就好比说互联网是“一个看视频的地方”。技术上讲没毛病,但完全没抓到重点。

停下来想一想这个词:基础设施。公路、电网、供水系统。这些是维持文明运转的根基,除非坏了,否则没人会想起它们。AI 正在变成这种东西:无影无踪,却又必不可少,而且建造费用极其昂贵。

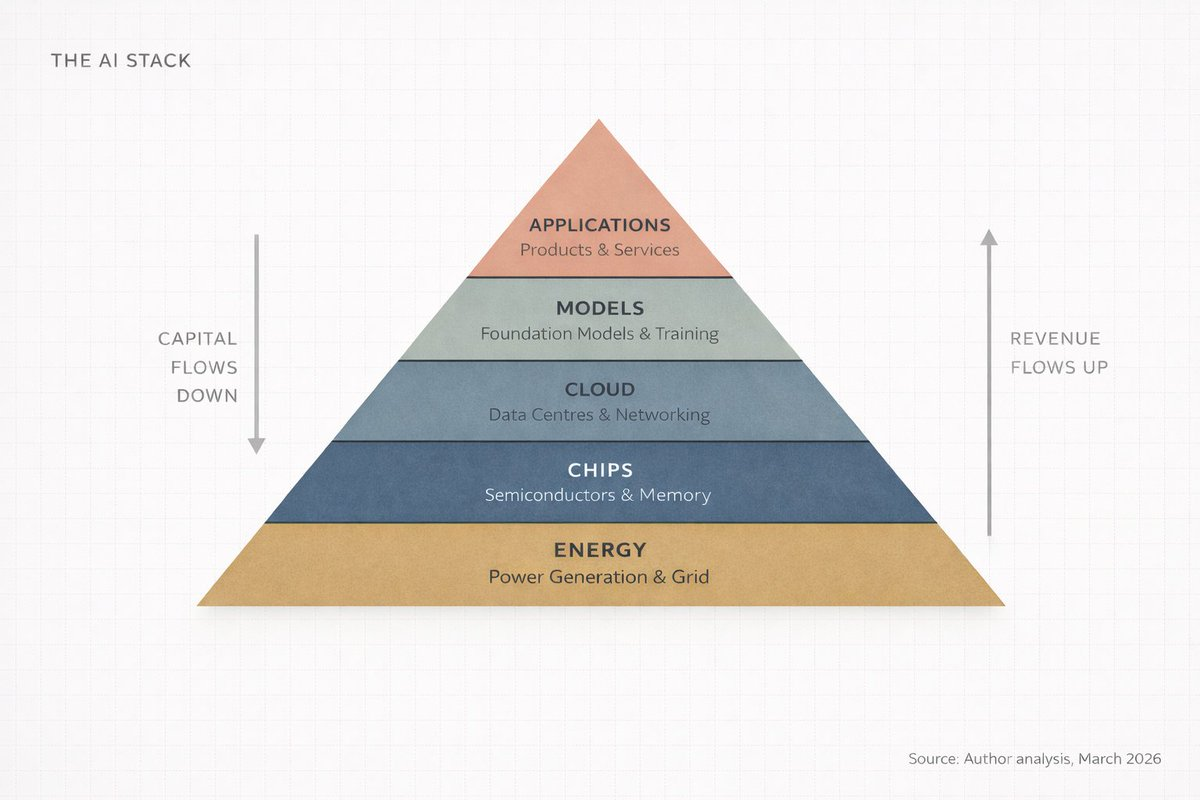

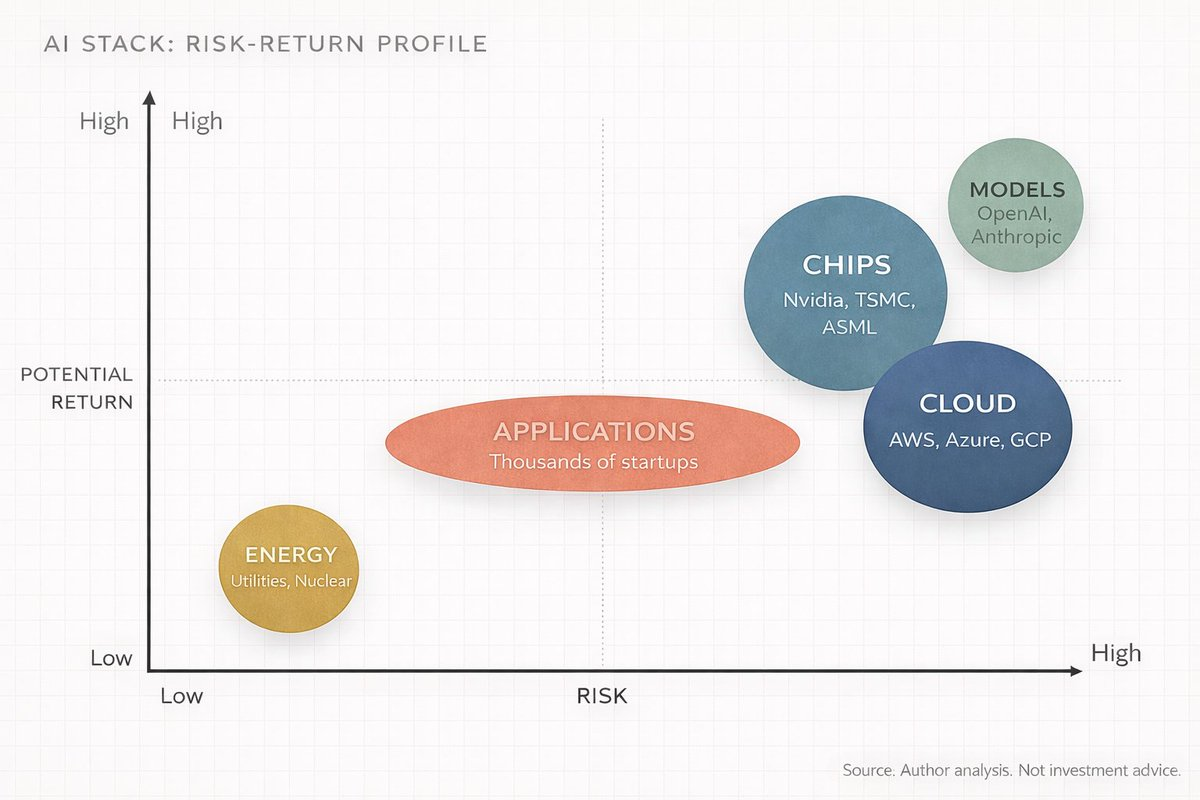

我称之为 “AI 架构栈”(AI Stack)。五层结构相互堆叠,每一层都为上一层提供养分,而资金则在各层之间双向流动。

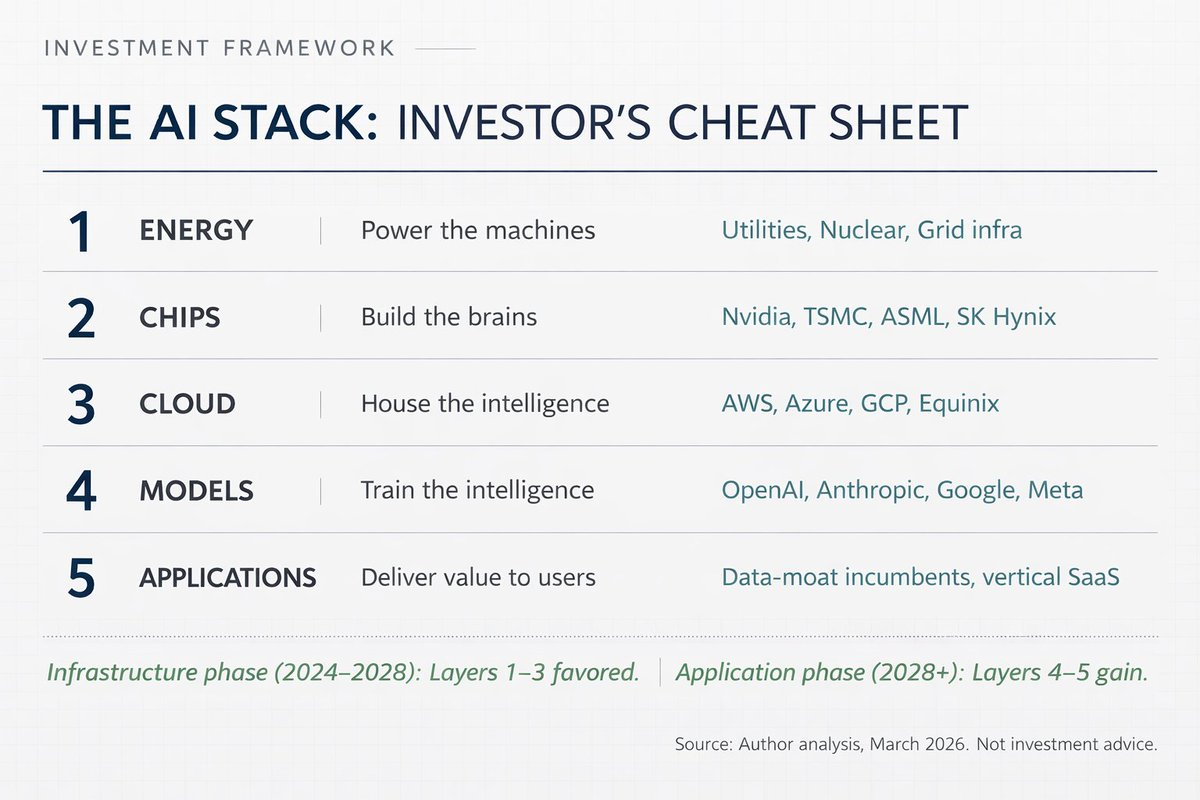

这是我能给出的最简明版本:

- 能源: 你需要电力来驱动电脑。巨量的电力。

- 芯片: 你需要专门的处理器来进行数学运算。这可不是你笔记本电脑里的那种 CPU。

- 云: 你需要装满这些芯片的巨大仓库,并用极速网络将它们连接起来。

- 模型: 你需要真正的 AI 软件,即从数据中学习模式的“大脑”。

- 应用: 你需要人们真正使用的产品。比如 ChatGPT、谷歌搜索、或者你银行的欺诈检测器。

任何只盯着“第五层”谈论 AI 的对话,都忽略了 80% 的全貌。

而且,如果你是投资者、创业者,或者只是想弄清世界走向的普通人,有一点至关重要:资金在这些层级之间的流动并不是均匀的。 它在聚集,它在复合。而眼下,资金正聚集在大多数人还没关注到的地方。

02 追随资金的流向(它不在你以为的地方)

提到 AI,每个人的脑海里浮现的都是应用层:ChatGPT、Copilot、Claude、Perplexity。因为这些是你触手可及的产品,所以它们感觉起来就是故事的全貌。

但这里正是所有人都会忽略的一点。

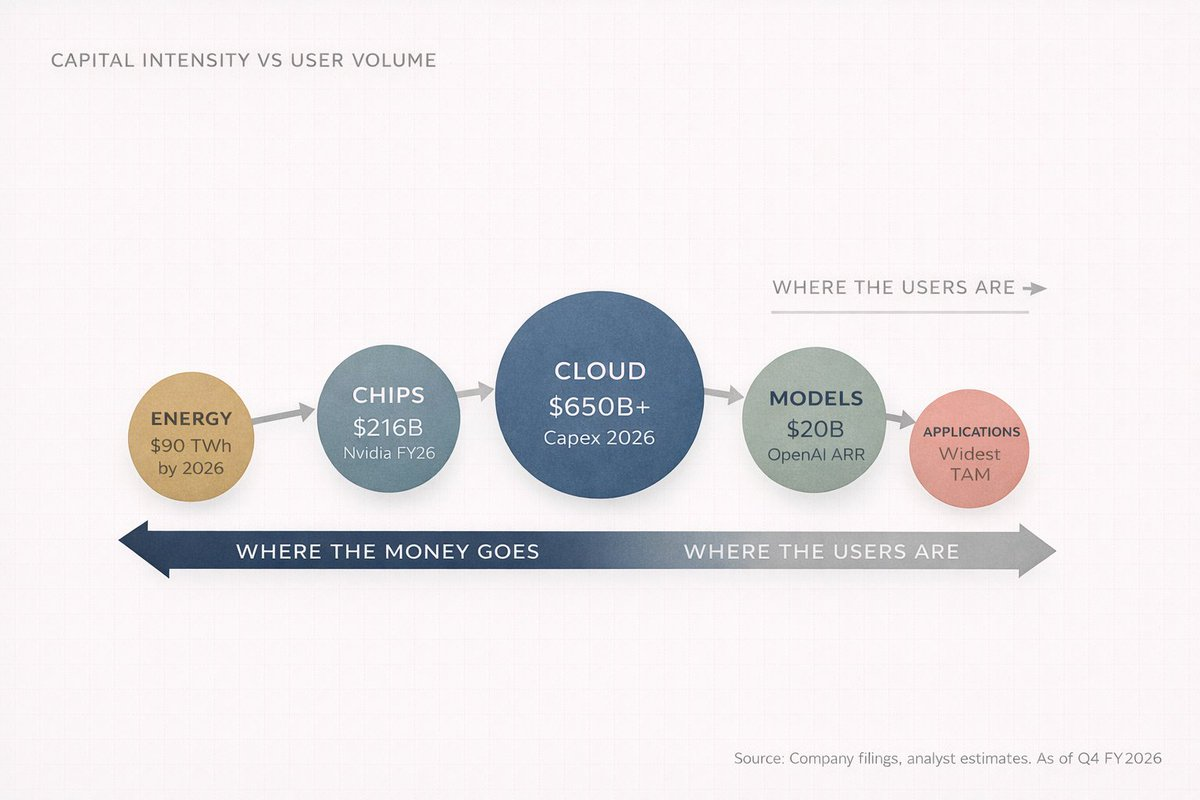

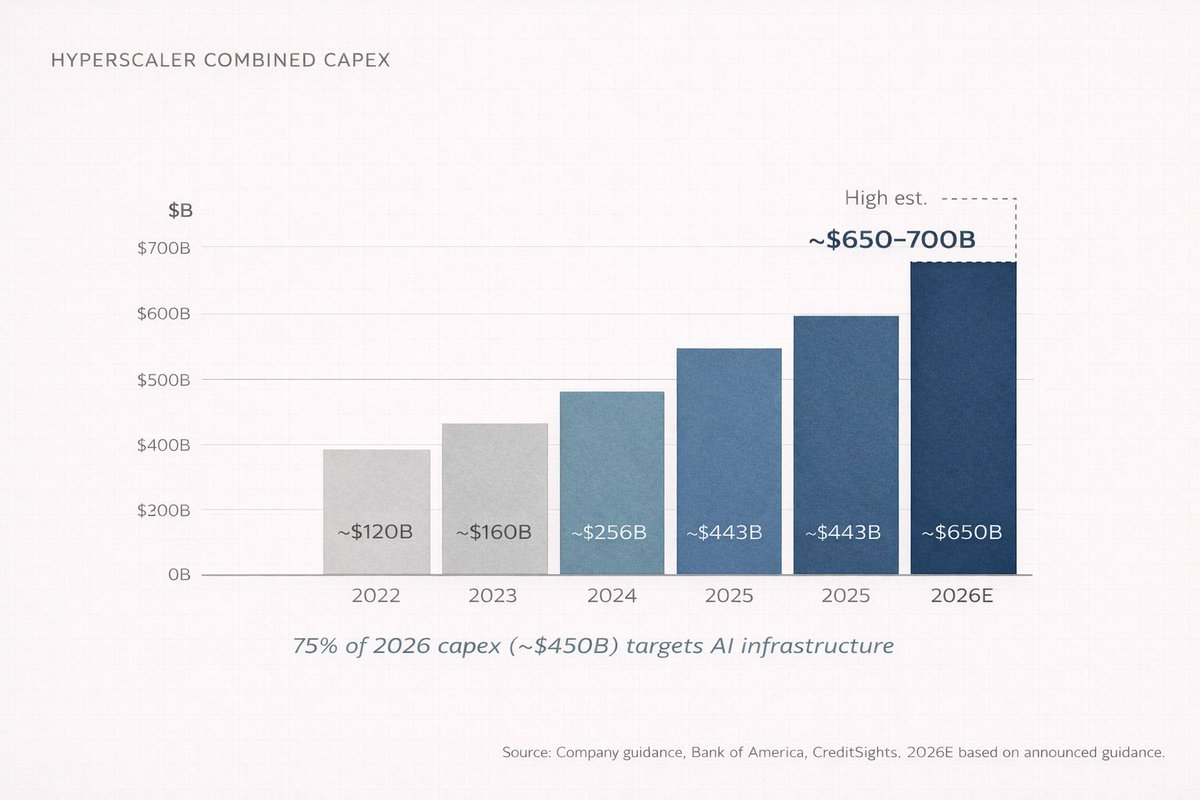

2026 年,四大云巨头(亚马逊、微软、谷歌和 Meta)全年的资本支出预计将达到 6500 亿至 7000 亿美元。 请注意,这只是他们一年的支出。这个数字大致相当于瑞士全年的 GDP。而其中近 75%(约 4500 亿美元)将直接投入到 AI 基础设施中。

不是投给聊天机器人,也不是投给 App。而是投给了厂房、芯片、电缆和散热系统。

在酒会上没人会聊这些东西,这恰恰证明了钱到底在哪里。

因为仔细想想:在任何人能用上 ChatGPT 之前,必须有人先盖起一座商场规模的数据中心,在里面填满数以万计的专用处理器,用比大多数公司身价还贵的网络设备将它们连接起来,然后每天为这尊巨兽喂下足以供养一座小城市的电力。

这就是从第一层到第三层——那些“隐形”的层级,也是核心资本正在大规模部署的领域。

“那 OpenAI 呢?他们不是日进斗金吗?”

确实如此。到 2025 年底,OpenAI 的年度经常性收入(ARR)已达到 200 亿美元,而一年前是 60 亿,再前一年仅为 20 亿。两年增长 10 倍,历史上从未有任何公司能在这个体量上实现如此神速的规模扩张。

但问题在于: OpenAI 在 2025 年烧掉了约 90 亿美元现金,并预计 2026 年将烧掉 170 亿美元。他们的推理成本(即当你向 AI 提问时,维持其运行的实际成本)在 2025 年达到了 84 亿美元,预计 2026 年将飙升至 141 亿美元。他们预计要到 2029 年或 2030 年才能实现现金流转正。

那么,这些烧掉的钱去哪儿了?

它们顺着架构栈向下流动。 流向了微软 Azure(到 2032 年前,OpenAI 收入的 20% 都要上缴给微软);流向了英伟达去买芯片;流向了那些建造和装备数据中心的公司;流向了发电的电力公司。

如果你盯着这套逻辑看久了,会发现它几乎是一个闭环:微软投资 OpenAI,OpenAI 把这笔钱花在 Azure 上,Azure 再用这笔收入去买更多的英伟达芯片,英伟达发布创纪录的财报,全员欢庆。而现金,就这样源源不断地向下流淌。

大多数用户都在架构栈的最顶端,但绝大部分利润却留在了最底层。 这种错位,就是本文的核心论点。

这是 AI 价值链的第一课:收入向上流动,资本向下沉淀。

03 这部电影你以前看过

“人类所有的难题本质上都是工程问题,而工程问题是可以解决的。” —— 巴克敏斯特·富勒(Buckminster Fuller)

如果你想理解 AI 正在发生什么,去研究一下 1880 年到 1920 年间电力行业发生了什么。

1882 年,当爱迪生在曼哈顿珍珠街建立第一座商用发电站时,人们觉得电力不过是个新鲜玩意儿。一种昂贵的照亮房间的方式。既然煤气灯用得好好的,为什么还需要这东西?

然而在随后的 40 年里,电力重组了地球上的每一个行业:制造业、交通、通信、医疗、娱乐。最终胜出的公司并不是那些发明了灯泡的公司,而是那些建造发电厂、铺设铜线、制造发电机的公司。

比如通用电气、西屋电气、公用事业公司、采铜商以及建筑商。

同样的模式正在 AI 身上重演,只不过时间从几十年压缩到了短短几年。

AI → 数据中心 → 芯片 → 原材料 → 能源

电力 → 工厂 → 机器 → 原材料 → 煤炭/水力

这两个演进路径几乎完全一致。而且,赢家再次不是主要出现在应用层,而是在基础设施层。

我称之为 “基建引力”(Infrastructure Gravity)。每当一个新的计算平台出现,最初的财富创造总是发生在“卖铲子”的环节。应用层虽然赚足了眼球,但基础设施层才赚到了利润。

英伟达在 2026 财年(截至 2026 年 1 月)公布的全年营收为 2159 亿美元,同比增长 65%。仅其数据中心业务在最后一季度就创下了 623 亿美元的营收,同比增长 75%。这单一业务目前占到英伟达总营收的 91% 以上。想想看:一家公司一个季度的营收达到 680 亿美元,而其中每 10 块钱就有 9 块来自同一条业务线。

台积电——这家实际负责代工英伟达(以及几乎所有人)芯片的公司——在 2025 年占据了全球代工市场近 70% 的份额,销售额达 1225 亿美元。最接近的竞争对手三星仅占 7.2%。这种统治地位之高,连当年的标准石油(Standard Oil)恐怕都会感到不安。

基础设施总是最先获胜。 唯一的问题是,这个窗口期会持续多久。

去问任何人互联网革命意味着什么,他们会说是谷歌、亚马逊和 Facebook。但去问问早期的钱实际上是被谁赚走了,答案是思科、康宁以及那些铺设光纤的公司。同样的故事,不同的年代。

04 没人想听的实话

“股市是一个将金钱从急躁者手中转移到耐心者手中的装置。” —— 查理·芒格(Charlie Munger)

我也诚实交代一件事:当我最开始以投资者的身份关注 AI 时,我也犯了大多数人都会犯的错误。

我盯着应用层看。我看到 ChatGPT 在增长,看到 Anthropic 融资数十亿。我当时想:既然 AI 公司会赢,那就投 AI 公司。

随后,三件事改变了我的想法。它们接踵而至,这很重要,因为每一件事都是在前一件的基础上建立的。

第一,我注意到几乎每一家“AI 公司”都在大出血。 OpenAI、Anthropic、Mistral、xAI,全都入不敷出。这并非因为它们业务糟糕,而是因为计算成本是结构性的。你每问模型一个问题,生成答案都需要实打实的成本。而且模型越聪明,需要的算力就越多,运行成本也就越高。

你心目中的那些“AI 赢家”,实际上正是花钱最凶的人。

第二,我意识到基础设施公司正在以我自谷歌早期以来从未见过的利润率疯狂印钱。 英伟达的毛利率维持在 75% 左右。台积电在扩大产能的同时还在涨价,因为需求远超供应。这些公司没有“何时才能变现”的烦恼,他们的烦恼是“产能实在跟不上”。这完全是两码事。

第三,也是最让我不适的一点,我意识到自己此前一直是以“消费者”而非“工程师”的视角在思考 AI。 消费者看到的是 App,工程师看到的是架构栈。

一旦你透视了架构栈,你就再也无法回到过去了。

每一次 AI 发布会都变成了“资本支出”公告。每一次模型升级都变成了“芯片订单”。每一个新功能都变成了“数据中心租赁”。整个行业看起来就像一系列同心圆,越往中心走,利润就越集中。

所以,无论你是关注 AI 模型的软件工程师,还是在英伟达 300 美元时入场、正试图预判下一步的个人投资者,亦或是远在印度注视着这场革命并思考它与你的投资组合有何关联的人。(或者你三者兼而有之,那将是最有趣的立场。)

无论你身处何地,原则都是一样的:消费者看产品,投资者看供应链。 而顶尖的投资者,在产品还没发货前,就已经看透了供应链。

当然,事后看来这一切似乎顺理成章,但当时并非如此。我为此纠结了数周,不得不强迫自己“清空”很多从 SaaS 时代学来的思维定式——在那个时代,价值主要积累在应用层。我曾执着于寻找“下一个 OpenAI”,而实际上我本该去看看 OpenAI 到底把支票开给了谁。

AI 与 SaaS 在结构上截然不同。其算力需求如此庞大,导致在当前周期的这一阶段,基础设施层攫取了更多的价值。

理解了架构栈,就会改变你解读每一条新闻的方式,改变你评估每一家公司的方式,改变你配置资本的方式。

05 投资者地图:逐层拆解

好了,篇幅有点长了,我加快点节奏。以下是 AI 架构栈每一层的详细分解:那里正在发生什么、谁是重要玩家,以及投资机会藏在哪里。

请跟紧我的思路。

第一层:能源

AI 数据中心是极其恐怖的“电老虎”。一次大型 AI 训练所消耗的电量,相当于一个小城镇一年的用电量。预计到 2026 年,这些设施每年将消耗约 90 亿度(90 TWh)电,几乎是 2022 年水平的 10 倍。

这产生了一个极其简单的投资逻辑:谁能发电、输电并为数据中心提供可靠能源,谁就能获益。 比如位于大型数据中心集群附近的核能、天然气和可再生能源公司;拥有过剩产能的公用事业公司;以及建造电网基础设施的公司。

黄仁勋在 2025 年 10 月直截了当地说:“数据中心自建发电系统的速度可能比接入电网要快得多。”一些公司已经开始在数据中心旁直接建设专用电站,完全绕过电网。这一点让我很吃惊——这些科技巨头基本上正在变成自己的电力供应商。

- 受益者: 公用事业公司(尤其是拥有核能发电能力的)、独立发电商、生产变压器/开关柜等电气设备的公司。在印度,随着超大规模云服务商(Hyperscaler)园区在亚洲扩张,电力设备和输电领域的公司将迎来机遇。

第二层:芯片

这是因为英伟达而名声大噪的一层。但其复杂程度远超单一公司。

芯片层有自己的子层级,每个子层级都有不同的竞争格局:

- 设计方: 负责芯片架构设计。英伟达 (GPU)、AMD (GPU 和 CPU)、博通 (定制 ASIC)、高通,以及越来越多的云巨头自研芯片(谷歌 TPU、亚马逊 Trainium、微软 Maia)。

- 制造方: 台积电(TSMC)统治着代工领域,占据全球近 70% 的份额。三星以 7.2% 苦苦追赶。英特尔正试图重塑代工业务,但这是一个前途未卜的多年期工程。

- 设备方: 制造“制造芯片的机器”。ASML 是全球唯一能制造最先进芯片所需极紫外光(EUV)光刻机的公司。应用材料(Applied Materials)、泛林(Lam Research)和东京电子(Tokyo Electron)紧随其后。

- 下游支撑: 内存(SK 海力士、三星和美光是三大关键玩家,AI 模型需要海量的高带宽内存 HBM)和封装(如台积电的 CoWoS 先进封装技术已成为真正的瓶颈)。

这一层的集中度是我反复研究的重点:英伟达占据了 AI 数据中心 GPU 市场约 92% 的份额;台积电为几乎所有主流芯片公司代工;ASML 则是全球唯一的 EUV 光刻机供应商。

一家公司设计,一家公司建造,一家公司制造建造用的机器。 这种高度集中既是投资逻辑,也是地缘政治风险。我觉得很少有人能同时深入思考这两点。

第三层:云与数据中心

这是芯片的“家”。巨大的仓库式设施里挤满了服务器,由高速网络连接,并由日益复杂的散热系统进行温控(液冷已成为标配,而非选配)。

市场由三大巨头主导:AWS (31% 份额)、微软 Azure (24%)、谷歌云 (11%)。甲骨文 (Oracle) 也在激进追赶,其 2026 年的资本支出目标高达 500 亿美元。

但云层级远比三大巨头更深:

- 富士康 (鸿海): 现在组装了全球约 40% 的 AI 服务器。

- Arista Networks & Credo Technology: 负责连接一切的网络基础设施。

- 维谛 (Vertiv): 处理液冷散热。

- 数据中心 REITs(房地产投资信托): 如 Equinix 和 Digital Realty,它们拥有土地和厂房。

据美银(Bank of America)估计,三大云巨头 2026 年将把 90% 的经营现金流投入资本支出,远高于 2025 年的 65%。摩根士丹利预计,这些公司今年将举债超过 4000 亿美元来资助这一建设规模,是 2025 年(1650 亿)的两倍多。单年发债 4000 亿美元只为盖计算机仓库,这个数字第一次读到时让我目瞪口呆。

第四层:模型

这是“大脑”层。

- 大玩家: OpenAI (GPT 系列,200 亿+ ARR)、Anthropic (Claude,预计 2026 年初年化收入约 190 亿)、谷歌 DeepMind (Gemini)、Meta AI (Llama 开源系列)、Mistral 以及 xAI (马斯克的 Grok)。

这一层最令我着迷,因为它既是热度最高的,又是最不赚钱的。OpenAI 收入增速史无前例,但 2026 年要烧掉 170 亿美元。

其商业模式存在结构性问题: 模型越强,算力投入越高,但投入的增长速度超过了收入。这有点像开餐厅,每一道菜的食材都比上一道贵,但顾客却希望价格不变。利润空间被极度压缩。我不知道这种情况何时改变,也许永远不会。

对于投资者,这一层是高风险、高潜在回报。大多数公司是私有的,你只能通过云服务商(如微软持有 OpenAI 大量股份)或芯片公司间接获益。

第五层:应用

这是你每天看到的层级:ChatGPT、由 Gemini 驱动的谷歌搜索、Office 里的 Copilot、银行的 AI 欺诈检测、Netflix 推荐、手机照片增强。

应用层最宽广、竞争也最激烈。它最终会成为总潜在市场(TAM)最大的一层(有估计称到 2030 年代初将超过 2 万亿美元),但目前也是利润最薄、胜负最难料的一层。

这一层的差异化在于数据。 拥有独特、专有数据的公司将建立持久优势。Salesforce 拥有企业 CRM 数据,彭博拥有金融数据,Epic 拥有医疗记录。坐拥这类“数据护城河”的公司,可以对模型进行通用机器人无法企及的精细微调。

总结: 未来 3 到 5 年的最佳回报路径大概是:现在看基建,以后看应用。 聪明的资本已经完成了布局。真正能在第五层胜出的,是那些坐拥他人无法获取的数据的公司。而其中大多数,目前甚至还没把自己标榜为“AI 公司”。

06 “但这难道不是泡沫吗?”

“投资者的主要问题,甚至是他最可怕的敌人,很可能就是他自己。” —— 本杰明·格雷厄姆(Benjamin Graham)

让我直接谈谈那个大家都在回避的焦点问题。

“那互联网泡沫破裂呢?这难道不是一回事吗?巨额的基建支出、没有盈利、每个人都陷入狂热?”

问得好。这值得一个严肃的回答。

区别在于: 在互联网泡沫时期,各公司是在为尚未落地的需求建设基础设施。他们为还在用拨号上网的用户铺设光纤网络和网页服务器。基础设施建好了,但需求在随后的 5 到 7 年里都没出现,这期间的一切都被清算了。

而到了 2026 年,AI 的需求已经实实在在地在那儿了。 英伟达生产芯片的速度赶不上订单;台积电的先进封装产能被抢购一空;云计算的租赁价格在上涨而非下跌。单是 2025 年 3 月到 10 月间,OpenAI 的周活跃用户就增加了 4 亿。模型正在被使用,算力正在被消耗,客户正在买单。

这并不意味着没有风险。风险巨大,而且我想起这些风险的次数比我愿意承认的要多。尤其是以下三点:

第一,资本错配。 2026 年,各公司在数据中心上的支出超过 6500 亿美元。如果 AI 服务带来的收入增长不够快,无法支撑这一支出,其中一些公司将面临严重的利润收缩。亚马逊今年的自由现金流甚至可能转负——那可是亚马逊,云计算的开山鼻祖。

第二,集中度风险。 AI 供应链的集中程度到了危险的地步。台积电代工了全球近 70% 的芯片,ASML 是 EUV 光刻机的唯一供应商,英伟达设计了 92% 的 AI 数据中心 GPU。任何变故(地缘政治、自然灾害或竞争因素)都会波及整个架构栈。台湾新竹的一次地震,就可能让全球 AI 发展倒退数年。这个念头理应让你感到不安。

第三,“DeepSeek”之问。 2025 年 1 月,中国 AI 实验室 DeepSeek 发布了一个模型,以极低的训练成本达到了顶尖性能。这挑战了一个假设:即“砸钱越多,AI 越强”。如果开源和高效模型继续缩小差距,那么“狂砸基建”的逻辑就会动摇。我不认为 DeepSeek 终结了这个逻辑,但它引入了一个前所未有的变量,而这类变量一旦出现就不会消失。

但我始终坚守的一个框架是:麦肯锡预计,到 2030 年,全球数据中心累计投资可能达到 6.7 万亿美元;普华永道预计,到 2030 年,AI 将为全球 GDP 贡献 15.7 万亿美元;IDC 则预计,到 2030 年,AI 解决方案和服务将产生 22.3 万亿美元的累计影响力。

即使这些数据有一半是错的,我们谈论的依然是自互联网以来,由技术驱动的最大规模的经济转型。 这是一个关于“量级”的问题,而不是关于“方向”的问题。

我一直听到有人说“我对 AI 持怀疑态度”,仿佛这是一种立场。没问题,你可以怀疑模型,怀疑时间表。但千万不要对供应链一无所知。 这是两码事。前者是一种健康的思维姿态,而后者会让你赔钱。

五年后,赢下这一周期的名字会显得顺理成章,向来如此。现在的游戏,就是在所有人反应过来之前,看清底层的结构。

07 在正确的层级玩这场游戏

把 AI 想象成一个有五个关卡的视频游戏,关卡之间层层堆叠。

- 第一关:能源是新手村。它是必经之路,虽然不怎么光鲜,但只要你玩,几乎就不可能输。风险低,收益稳。可以把这些公司看作是那些永远不会阵亡、且总是会给你派发奖励的 NPC 任务发放者。

- 第二关:芯片是Boss之战。这里权力最集中、利润最高,但也是最容易受到颠覆和地缘政治风险冲击的一层。奖励极其丰厚,但难度被设为了“困难模式”。

- 第三关:云是多人服务器。所有人都在这儿玩。超大规模云服务商就是服务器管理员,他们对这里发生的一切都要抽成。

- 第四关:模型是 PvP 竞技场。这里有残酷的竞争和极速的创新,大多数玩家都会被淘汰,只有装备最精良的才能活下来。

- 第五关:应用是开放世界。这里有无限可能,但没有保底掉落,你得自己去寻找任务。

核心策略其实很简单:你不需要打通所有五个关卡。 大多数人因为第五关最显眼而扎堆去那里,但“聪明钱”正在第二关和第三关“刷怪成佛”,因为目前那里的经验值(XP)最高。

你在架构栈中所处的位置,决定了你应该关注什么:

- 对于非技术人员: 你不需要理解 GPU 是如何工作的。你只需要理解:必须有人去制造它们,有人去安置它们,有人去为它们供电。而这些“某人”都是上市公司,你可以阅读他们的季度财报。

- 对于技术人员: 你已经知道模型会越来越强。但你可能低估了物理约束(电力、散热、芯片封装)正以多快的速度成为制约发展的瓶颈。未来十年 AI 的进步,将取决于工程实现,而非论文架构。

- 对于投资者: AI 价值链是五个叠加在一起的交易机会,每个机会都有不同的风险回报比、不同的时间跨度以及不同的赢家。把“AI”视为一个单一板块,就像在 1998 年把“科技”视为一个单一板块一样错误。AI 内部最好和最坏结果之间的差距是巨大的。

这种现状不会永远持续下去。在某个时间点,基建扩张会趋于成熟,应用层会完成整合,价值也会像互联网时代那样向架构栈的上方转移。亚马逊、谷歌和 Facebook(互联网时代的应用层)最终攫取的价值超过了光纤公司和服务器厂商。

但 AI 还没走到那一步。我们仍处于基础设施阶段,处于“卖铲子”的阶段。而卖铲子的人正在疯狂印钱。

理解全栈的人会在转型发生前洞察先机。而其他人则会一次又一次地对资金的流向感到惊讶。

十年后,理解 AI 架构栈将像看懂资产负债表一样成为基本功。

吃透架构,理清层级,追随资本。这就是这场游戏的玩法。